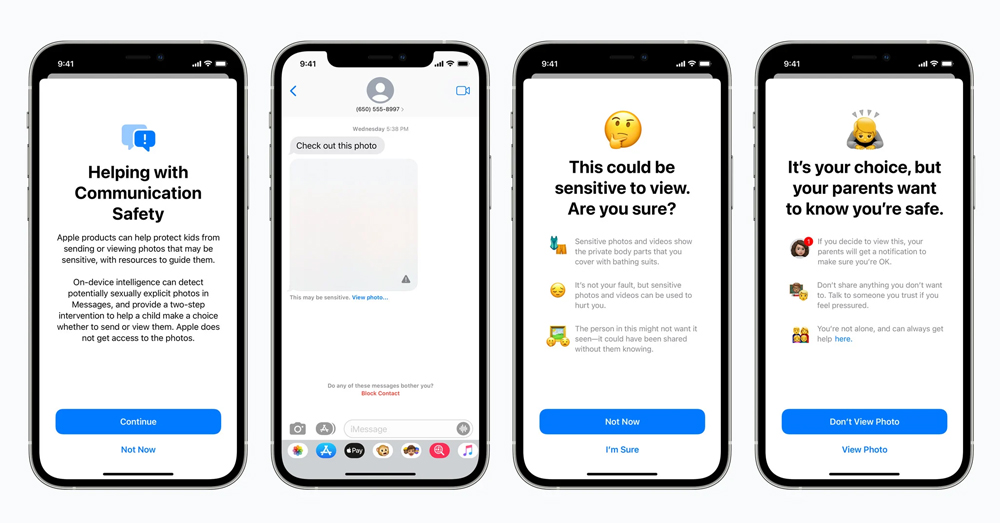

Apple เตรียมเพิ่มฟีเจอร์ AI ตรวจจับภาพสื่อลามกอนาจาร ไม่ว่าจะเป็นรูปภาพโป๊ต่างๆ รวมเนื้อหาที่ส่อถึงการล่วงละเมิดทางเพศเด็ก Child Sexual Abuse Material (CSAM) ในแอป Message

โดย AI จะตรวจภาพที่เข้าข่าย หากพบเจอภาพที่เข้าข่ายในแอป Message จะก็จะทำการเซ็นเซอร์ไว้ หากเด็กกดเปิดหรือพยายามขอดูภาพจะมีข้อความขึ้นเตือนบนหน้าจอ หากยังยืนยันที่จะดูภาพ จะมีข้อความส่งไปแจ้งผู้ปกครองให้รับทราบ ส่วนในกรณีส่งภาพหน้าจอจะขึ้นคำเตือนทันที และจะส่งข้อความแจ้งผู้ปกครองหากเด็กยืนยันที่จะส่งภาพอยู่

ซึ่งฟีเจอร์นี้จะใช้กับบัญชี iCloud แบบ Family เท่านั้น และจะใช้งานได้ทั้งบน iPhone, iPad, และ Mac บน iOS15, iPadOS 15, watchOS 8, and macOS Monterey

ที่มา: Apple